#16 TPU 之父、Groq 創辦人 Jonathan Ross 的 AI 預言:Nvidia 市值突破 10 兆美元、OpenAI 與 Anthropic 終將自造晶片

AI 之於人類更深層的意義,在於這或許是人類文明第一次面臨這樣的局面:我們集體智慧的上限,不再由我們天生的腦力或創造力所決定,而是被我們建造和驅動機器的物理能力所限制。

過去幾個月關注 AI 發展的人,大概都會注意到一個越來越常被提起的問題——「AI 會不會是自網際網路商業化以來,資本市場最大的泡沫?」隨著 Nvidia 股價不斷創下歷史新高,這樣的討論熱度也一路攀升。只是,大部分相關的辯論,仍停留在股價本益比、季度營收成長等短期指標上,彷彿整個故事線只剩財報與估值的起伏。這樣的討論方式,總讓人覺得視野過於狹窄。

相比之下,TPU 之父、Groq 創辦人暨執行長 Jonathan Ross 近期在 YouTube 頻道《20VC with Harry Stebbings》的分享,提供了一個完全不同的視角。他把時間軸拉長到三到五年以上,回到更根本的層面——商業模式的演化、技術典範的轉移,以及整個產業的經濟效益結構。

Ross 的觀察之所以特別有分量,正因為他親身經歷過兩個關鍵轉折點:一個,是他在 Google 領導 TPU 專案、開啟 AI 專用晶片時代的那一刻;另一個,則是如今帶領 Groq 嘗試突破 Nvidia 壟斷,重構「推理時代」(Inference Era)的新秩序。這樣的背景,讓他不只是評論者,而是一位同時見證、甚至參與兩場技術革命的建築師。我把這場精彩分享中的幾個重要觀點,加上個人(超譯)解讀,寫成這篇心得整理。

來自 AI 老將的觀察和預言

當我們談論人工智慧(AI)時,腦中浮現的往往是 ChatGPT 流暢的對話、Sora 生成的逼真影片,或是一個個聰明絕頂的數位助理。我們看見的是螢幕上流動的智慧之光。然而,在這片看似無形的數位疆域之下,一場截然不同、更加原始且殘酷的戰爭正在上演。這場戰爭無關演算法的優雅或模型的詩意,而是關於物理世界的極限——關於矽、電力、以及冰冷的基礎設施。

這是一場看不見的戰爭,而 Groq 創辦人暨執行長 Jonathan Ross,則提出他對這片隱形戰場的觀察。最近,在 YouTube 頻道《20VC with Harry Stebbings》的一場深度對談中,來自英國的創投家 Harry Stebbings(圖右) 邀請了 Jonathan Ross(圖左)。

Harry Stebbings 個人經歷,也同樣精彩。他在 2015 年、年僅 18 歲時,用區區 50 美元和零人脈,創立了Podcast《The Twenty Minute VC》(簡稱 20VC)。這個節目憑藉著犀利、深入的訪談風格,迅速成為創投、新創與科技產業的必聽內容,至今已累積數億次下載。Harry Stebbings 的成功,完美演繹了「內容即人脈」的力量,他不僅透過高品質內容建立起扎實的個人品牌,更在 2020 年順勢成立了自己的創投基金 20VC Fund,如今管理著超過 6 億美元的資產。

當 Harry Stebbings 訪談 Jonathan Ross,交流的內容之所以如此有份量,不僅因為 Jonathan Ross 創立了估值近 70 億美元的 AI 晶片新創 Groq,更因為他那段幾乎是無心插柳的過去。在 Google 任職期間,他還只是一位負責廣告業務的軟體工程師。在紐約辦公室吃午餐時,他時常聽到語音辨識團隊的同事抱怨運算能力嚴重不足。出於好奇與挑戰心,他決定將這個問題當作 Google 著名的「20% 自由時間專案」來處理。白天,他繼續做著本職工作;晚上,他則帶領團隊,從零開始研發機器學習加速器。

這個最初的 Side Project,最終演變為 Google 的第一代 TPU(Tensor Processing Unit,張量處理單元)。這個被他戲稱為「成功的災難」的發明,不僅在短短幾年內支撐了 Google 超過 50% 的運算需求,更成為了 AlphaGo 擊敗棋王李世乭的歷史性勝利背後的無名英雄,也讓他洞悉了 AI 時代最核心的真理:一切的根源,都在於運算。

【延伸閱讀】Google 皇冠上 9,000 億美元的珍珠:因恐懼而誕生的 TPU,如何衝擊 Nvidia AI 帝國?

因此,當 Jonathan Ross 開口,我們聽到的不只是一位 CEO 的商業洞察,更像是一位從前線歸來的將軍,為我們揭示 AI 革命背後,那場關於晶片、能源與商業前景,價值數兆美元的基礎建設戰爭底層的真實面貌。

資本的洪流——是科技泡沫,還是不可避免的宿命?

訪談一開始,主持人 Harry Stebbings 就拋出了那個縈繞在每個人心頭的問題:「現在的 AI 市場,到底是不是泡沫?」

這個問題,在過去兩年裡,已經被無數次地辯論。但 Jonathan Ross 提供了一個更具穿透力的視角。他建議我們換個問題:「與其猜測是不是泡沫,不如看看『聰明的錢』正在做什麼?」

答案不言而喻。科技巨頭們,包括 Google、Microsoft、Amazon、Meta 等,正在以前所未有的規模,瘋狂地加碼對 AI 基礎設施的投資。他們不僅沒有縮手,反而每一次宣布的資本支出(CapEx)都比上一次更加驚人。

這不是空談,而是寫在財報上的冰冷數字。這場軍備競賽的規模,每家科技巨頭每年投資動輒數百億甚至上千億美元,完全是富可敵國的等級。

Jonathan Ross 用一個生動的比喻,來形容當前的 AI 市場:「就像早期的石油鑽探時代,很多人鑽了一堆乾井,但少數人挖到了噴井。」他提到,目前 99% 的 AI 營收,都集中在大約 35 到 36 家企業手上。這種贏家通吃的極端分佈,恰恰證明了市場仍處於一個非常早期的、充滿不確定性的階段。就像百年前的探勘者們,還不知道如何透過地質學分析來尋找油田一樣,現在企業對 AI 的投資,也還在憑著直覺和勇氣,在這片新大陸上瘋狂下注,希望能鑽到那口能改變世界格局的「AI 油井」。

這些動輒數百億美元的支出,如果純粹從短期財務回報來看,幾乎是荒謬的。但這正是問題的關鍵。Jonathan Ross 在阿布達比的一場高盛舉辦的活動中,向一群管理著百億美元資產的投資人提問:「你們有誰 100% 確定,十年後 AI 不會取代你們的工作?」全場鴉雀無聲,無人舉手。

這就是答案。科技巨頭們的瘋狂投資,並非基於傳統的投資回報率(ROI)模型,而是一種「生存必要性」。這不是一場經濟遊戲,而是一場攸關存亡的戰爭。想要留在「科技七巨頭」(Magnificent Seven)這個菁英俱樂部,就必須不計代價地投入。因為一旦掉隊,失去的將不僅是市場份額,而是整個公司的估值體系與未來。這場豪賭的邏輯,更接近於冷戰時期的核武競賽:建造核武不是為了獲利,而是為了確保自己不會在地圖上被抹去。

更重要的是,這場資本的洪流,已經開始從成本中心轉變為價值創造的引擎。Jonathan Ross 分享了 Groq 內部的一個真實案例:一次客戶會議中,對方提出了一個新功能的需求。他用非常高層次的自然語言(基本上是在對他的工程師團隊進行「提示工程」)描述了這個功能。四個小時後,這個功能就已經開發完成並上線了——沒有任何一行程式碼是人類寫的,也沒有經過人工除錯,一切都由 AI 自動完成。

這個故事揭示了一個深刻的轉變。Jonathan Ross 指出,我們試著想像一下,如果六個月後,這件事可以在客戶會議結束前就完成,那會是什麼樣的競爭優勢?當競爭對手還在會議室裡畫著白板、規劃著下個季度的開發排程時,掌握 AI 優勢的企業,已經把客戶想要的功能做出來了。這不再是節省幾個工程師成本的問題,而是一種質變,一種近乎降維攻擊的碾壓。掌握 AI 優勢的企業,將會贏得那些別人根本無法企及的訂單。

這意味著,當前的資本支出狂潮,並非單純的基礎設施升級,而是對全球數位經濟的一次徹底的「再平台化」(Re-platforming)。就像過去十多年來,企業 IT 架構從本地伺服器轉向雲端一樣,今天沒有投入 AI 基礎設施的企業,未來將會在一個過時的、無法競爭的平台上運作。

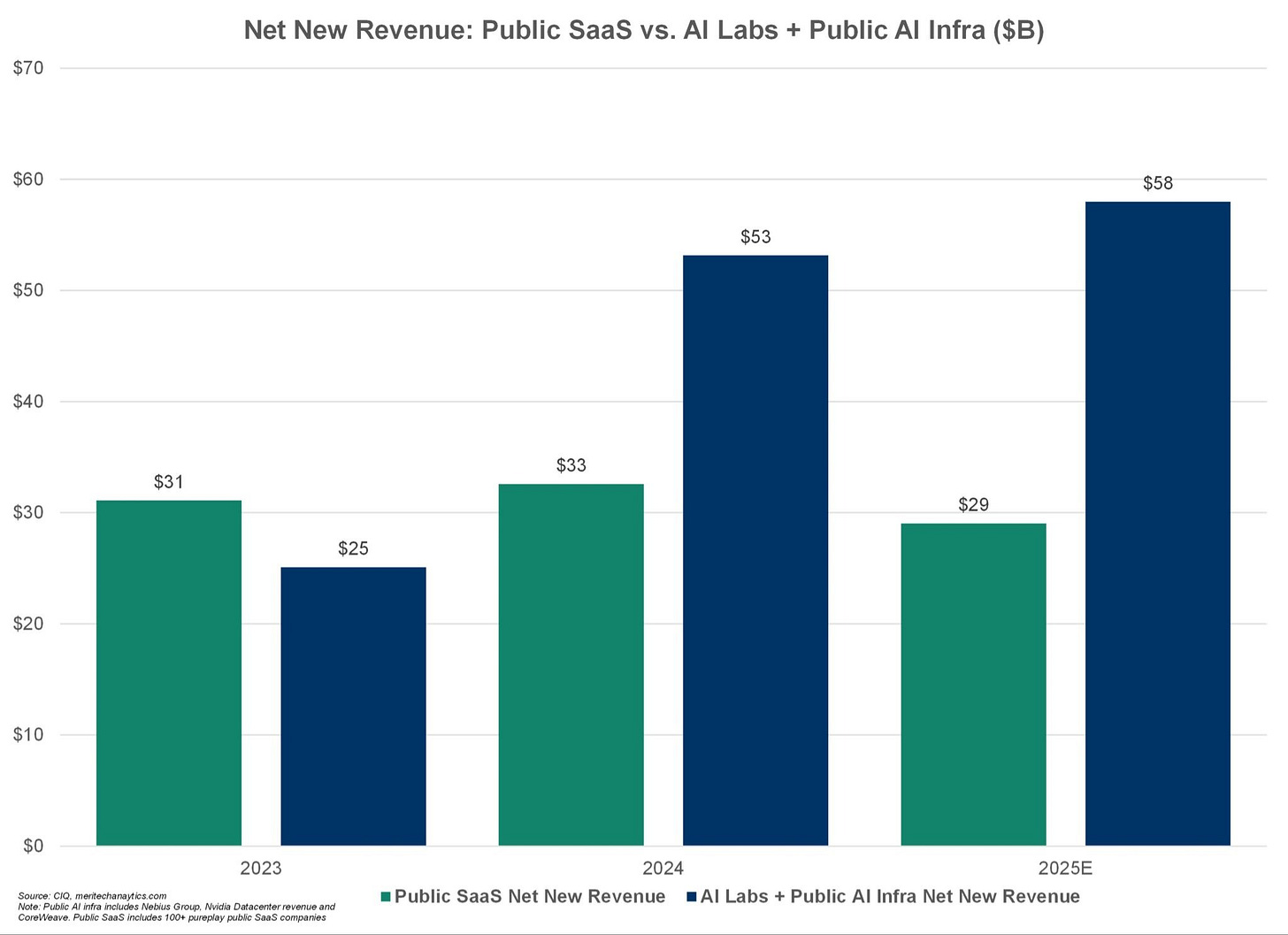

同時,AI 也徹底改寫了軟體經濟學的規則。在傳統的軟體即服務(SaaS)世界裡,產品品質是由工程師決定。一旦產品開發完成,每個客戶基本上是得到相同的服務。但 AI 完全改變了這個遊戲規則。在 AI 的世界裡,企業可以用運算資源「買」到更好的解決方案。例如,可以針對同一個問題執行兩次或更多次推理,然後從中挑選最好的答案給用戶。這意味著,產品品質不再是固定的,而是可以透過投入更多運算資源來動態提升。

這也催生了全新的商業模式。企業可以根據客戶的價值,來決定要投入多少運算資源。對於付費較高的客戶,可以執行更多次推理、使用更複雜的模型,從而提供更高品質、更「聰明」的結果。這正是 OpenAI 推出「Pro 模式」背後的邏輯:讓願意付更多錢的用戶,獲得更多的「思考時間」和更好的答案品質。這在傳統軟體世界是不可能的,我們不可能告訴 Salesforce:「我願意付兩倍的錢,讓我的 CRM 系統變得更聰明。」但在 AI 世界,運算能力確實可以直接購買產品品質。這也解釋了,為什麼所有 AI 巨頭們,都處於「運算受限」的狀態——因為誰擁有更多的 GPU、更有效率的晶片,誰就能提供更好的產品,或者以更低的成本提供相同品質的產品。

AI 永動機?解構 Nvidia 與 OpenAI 的共生關係

Jonathan Ross 這場大約一個月前的訪談中,當時有一個極具爭議性且引人入勝的話題,就是 Nvidia 與 OpenAI 之間那筆引人矚目的交易。Nvidia 宣布打算投資高達 1,000 億美元給 OpenAI,而 OpenAI 則承諾將利用這筆資金和未來的合作,部署至少 10 GW 的 Nvidia 運算系統。

從表面上看,這就像一個完美的閉環:Nvidia 把錢給 OpenAI,OpenAI 再用這筆錢向 Nvidia 購買晶片。這難道不是一場左手倒右手的金融遊戲,一台「AI 永動機」嗎?

Jonathan Ross 對此提出了更精闢的解構。他指出,這個循環並非 100% 封閉。實際上,大約只有 60% 的資金會直接流回 Nvidia。另外的 40%,則會像活水一樣,灌溉到整個龐大的半導體供應鏈生態系中。這筆錢會流向台積電進行晶圓代工,流向韓國的 SK 海力士(SK Hynix)和三星(Samsung)購買至關重要的高頻寬記憶體(HBM),也會流向封裝測試廠(OSATs),再流向伺服器製造商、網路設備公司以及資料中心的建構者。

然而,真正神奇的地方在於那回流的 60%。這筆錢對 Nvidia 而言,不僅僅是營收。在華爾街的眼中,這是對它技術領導地位和未來市場需求的終極背書。這 600 億美元的營收,可以被資本市場放大,轉化為數千億美元的市值增長。從股東價值的角度來看,這筆交易十分划算。這背後的信念基礎極其簡單而強大:世界上的運算能力是遠遠不夠的,需求趨近於無限。

這筆交易的深層意義,遠遠超出了財務操作。它揭示了 Nvidia 在這個新時代的真實角色:它不再僅僅是一個晶片供應商,而更像是「AI 經濟的中央銀行」。

在傳統經濟中,中央銀行透過調節貨幣供給和提供信貸,來刺激整個經濟體的成長。在 AI 這個新興經濟體中,最稀缺、最重要的資源不是美元,而是「運算能力」。Nvidia 透過它的 GPU,實質上控制了這個經濟體中「貨幣」的發行權。這筆 1,000 億美元的投資,就像是央行向最有潛力的「國家」(例如:OpenAI)提供了一筆巨額的基礎建設貸款,確保它能夠建立起龐大的「工業基礎」(AI 工廠)。

這個舉動不僅確保了 OpenAI 的持續成長,更重要的是,它刺激了整個 AI 產業鏈的需求。從晶圓代工到記憶體,再到散熱和電力系統,整個生態系都因為這筆「信貸擴張」而蓬勃發展。Nvidia 透過資助最大的客戶,確保了整個產業的繁榮,從而鞏固了自身「貨幣」(GPU)的價值和地位。

此外,這筆交易也是一步防禦性的棋子。我將在後文更深入探討,像 OpenAI 這樣的巨頭,終將走向自研晶片的道路,這對 Nvidia 構成了長期的潛在威脅。而這份長達數年的深度合作協議,就像一副「黃金手銬」。協議中不僅包括了晶片供應,更涵蓋了雙方未來軟硬體路線圖的共同優化與深度協作。

這意味著 OpenAI 的未來模型發展,將與 Nvidia 的硬體架構深度綁定。在這種情況下,即便 OpenAI 未來成功研發出自己的晶片,要將整個龐大的、基於 Nvidia CUDA 生態系統建立起來的研發管線和模型架構,遷移到一個全新的、未經驗證的自研晶片上,轉換成本和風險將是天文數字。Nvidia 透過這次合作,將 OpenAI 從一個單純的客戶,變成了一個深度綁定的生態夥伴,極大地增加了出走的門檻,從而巧妙地拓寬了自身的護城河。

速度的福音——為什麼多巴胺迴路建立在毫秒之上?

Harry Stebbings 另外提出了一個觀點:「AI 回應慢一點又何妨?我可以先去泡杯咖啡,等它跑完再回來看。」

Jonathan Ross 則反對這種觀點。他認為這完全誤解了人類心理和數位經濟的本質。為了闡述「速度就是一切」的理念,他引用了一個出人意料卻極具說服力的類比:在所有消費品中,利潤率最高的產品是什麼?答案是香菸。其次是嚼菸草,再來是軟性飲料。

這些高利潤產品的共同點是什麼?是它們的「有效成分」作用於使用者身體的速度。尼古丁、咖啡因、糖,這些物質能以極快的速度觸發大腦的獎勵中樞,釋放多巴胺,形成一個快速、強力的正回饋迴路。這個迴路越快,用戶的依賴性就越強,品牌忠誠度也越高。

這正是數位世界的黃金法則。Google 和 Facebook 這些網路巨頭,早已將速度奉為圭臬。Jonathan Ross 指出,網頁載入時間每加快 100 毫秒,轉換率就能提升約 8%。用戶的耐心,是以毫秒為單位計算。當 Groq 剛開始展示它 LPU 晶片快速的推理速度時,很多人質疑:「為什麼我需要一個比我閱讀速度還快的 AI?」Jonathan Ross 的反問一針見血:「那為什麼網頁載入需要比人類閱讀速度還快?」

這個問題的答案,揭示了 AI 互動模式的根本性轉變。我們正在從「指令式」互動,轉向「對話式」互動。過去,我們對電腦下達指令,然後等待結果,延遲是被預期的。但現在,我們與 LLM 的互動更像是與一個人類對話。在真實的對話中,尷尬的沉默和延遲會扼殺交流的流暢感。一個反應遲緩的 AI,給人的感覺就像是一個心不在焉、思考緩慢的對話夥伴,無論它最終給出的答案多麼完美,體驗都是破碎的、令人沮喪的。

因此,在 AI 時代,「延遲」本身就是一種糟糕的用戶介面(UI)。傳統軟體的使用者體驗(UX)由按鈕、選單和視覺設計定義。但在一個以文字或語音為主要介面的 AI 產品中,使用者體驗的核心,就是回應的速度。低延遲,就是最美的設計;毫秒級的響應,就是最流暢的動畫。

這正是 Jonathan Ross 創立 Groq 的哲學基石。Groq 的 LPU(語言處理單元)架構,就是為這個「速度至上」的未來而生。背後的核心技術被稱為「確定性運算」(Deterministic Computing)。我們可以將傳統的 GPU 運算,比作在尖峰時段的城市交通中開車:儘管我們知道起點和終點,但路上的紅綠燈、突發的交通堵塞,以及其他車輛的不可預測行為,都讓我們的抵達時間充滿了不確定性。每一次行程,時間都可能不同。

而 Groq 的 LPU 則像一場精心編排的芭蕾舞。在演出開始前,編舞家(編譯器)就已經規劃好了每一位舞者(數據)在每一個節拍(時脈週期)的精確位置和移動路徑。沒有意外、沒有延遲,一切都按照預定的劇本完美執行。這種架構去除了 GPU 中為了應對不確定性而設計的複雜調度機制和快取,從而實現了極低且高度一致的延遲。

Jonathan Ross 的賭注是,最終贏得 AI 應用戰爭的,將是那些能夠提供最快、最流暢、最接近即時對話體驗的產品。因為在數位世界裡,每一次毫秒級的勝利,都在用戶大腦中加固了一次多巴胺迴路,最終累積成不可撼動的品牌價值。

主權的賽局——為何 AI 巨頭必須打造自己的晶片?

當主持人 Harry Stebbings 提出另一個關鍵問題時,對話觸及了 AI 產業鏈權力結構的核心:「OpenAI 和 Anthropic 最終會自己製造晶片嗎?」

Jonathan Ross 的回答毫不猶豫:「他們終將這麼做,每一家 AI 巨頭都會。」但背後的原因,卻比大多數人想像得要複雜得多。許多人以為,自研晶片的目標是為了打造一顆比 Nvidia 更好、更便宜的晶片。然而,Ross 揭示了更深層的動機:「這不是為了超越 Nvidia,而是為了掌控自己的命運。」

他分享了一段在 Google 時期的親身經歷,這個故事完美地詮釋了這場權力遊戲的本質。當年,在 AMD 還在市場上苦苦掙扎時,Google 刻意採購並建造了一萬台搭載 AMD 晶片的伺服器。然而,在實驗室裡,工程師們卻把這些伺服器一台台地從機架上拆下,拔掉 AMD 晶片,然後直接扔進垃圾桶。

為什麼 Google 要耗費巨資去做一件看似徒勞無功的事?答案很簡單:為了在與當時市場的霸主 Intel 談判時,獲得更大的議價能力。當 Intel 的銷售代表走進會議室,Google 可以輕描淡寫地說:「如果你們的價格不夠有競爭力,我們隨時可以將下一批訂單轉給 AMD。」那一萬台被丟棄的伺服器,就是談判桌上最有力的籌碼。設計主機板、進行測試的成本,與從 Intel 那裡拿到的巨額折扣相比,簡直是九牛一毛。

這就是 AI 巨頭們自研晶片的真正目的。這是一場「主權賽局」。

要理解這場賽局,就必須先看清 AI 晶片供應鏈真正的瓶頸所在。許多人以為瓶頸是晶圓製造,但 Ross 指出,真正的咽喉要地,是 HBM(高頻寬記憶體)和先進封裝技術。

HBM 就像是為 AI 晶片量身打造的記憶體摩天大樓。傳統的 DRAM 記憶體像是在平地上鋪開的平房,數據存取需要走很長的路。而 HBM 則透過 3D 堆疊技術,將多層 DRAM 晶片垂直疊加在一起,並透過成千上萬條微小的通道(TSV,矽穿孔)直接與處理器相連,形成一條超寬的資訊高速公路,極大地解決了所謂的「記憶體牆」問題——即處理器運算速度,遠超記憶體供給數據速度的瓶頸。

然而,這種尖端技術的產能極為有限,主要掌握在 SK 海力士、三星和美光(Micron)等少數幾家公司手中。而 Nvidia 作為市場上最大的買家,對 HBM 擁有近乎「買方壟斷」(Monopsony)的地位。這意味著,Nvidia 能夠優先獲得絕大部分的 HBM 產能,從而決定了全球高階 AI GPU 的最終產量。

這就創造了一個權力極度不對等的局面。當一家 AI 巨頭向 Nvidia 索要 100 萬顆 GPU 時,Nvidia 可以輕易地以「產能有限」為由進行配額控制。但當這家巨頭宣布啟動自研晶片計畫,並開始直接與 SK 海力士或台積電接觸時,情況就發生了戲劇性的變化。這不僅僅是技術上的威脅,更是對 Nvidia 在供應鏈中議價能力的直接挑戰。Ross 認為,突然之間,Nvidia 很可能就會「找到」原本不存在的產能,來滿足這位重要客戶的需求。

因此,OpenAI 成立數十人的晶片團隊,並與博通(Broadcom)、台積電合作開發客製化晶片;Anthropic 則採取多雲戰略,同時採用 Google 的 TPU、Amazon 的 Trainium 晶片以及 Nvidia 的 GPU,這些舉動的本質,都是為了在與供應鏈霸主的博弈中,爭取到自己的「晶片主權」。他們追求的,不是在技術上推翻 Nvidia,而是在策略上擺脫對單一供應商的絕對依賴,確保自己的 AI 帝國,不會因為別人的產能分配,而在一夜之間斷糧。

這場變革也正在顛覆傳統科技業的價值鏈。過去,軟體公司以「輕資產」模式為傲,高高在上的軟體利潤建立在被視為大宗商品的硬體(台灣對這類硬體,有更經典的形容:毛三到四)之上。然而,AI 革命正在讓這個金字塔發生倒轉。硬體,特別是那些存在供應瓶頸的尖端硬體,重新成為了權力與價值的核心。這迫使那些曾經的「軟體之王」,不得不放下身段,投入數百億美元,重新變回重資產、垂直整合的「硬體玩家」。這不是一種選擇,而是在新權力格局下的生存之道。

解讀中國 AI 崛起的真實面貌

當談到中美 AI 競賽時,市場上常常充斥著各種簡化的敘事。當中國的 DeepSeek 等模型發布時,許多人的第一反應是:「天啊,他們追上來了,而且成本更低!」。

Jonathan Ross 在訪談中,對這種觀點進行了細膩的解剖。他指出,這是一個普遍的誤解,源於混淆了「訓練成本」與「推理成本」。要理解這一點,我們可以把 AI 模型的生命週期想像成蓋一座發電廠。訓練(Training)就像是設計和建造發電廠的過程,這是一個一次性(或週期性)的、極其耗費資源和時間的巨大工程。需要成千上萬的頂級 GPU,花費數月甚至數年,投入大量的資金來完成。

然而,一旦發電廠建成,真正決定商業價值的,是它每天運轉發電的成本和效率,這就是推理(Inference)。每當一個用戶向 ChatGPT 提問,或是一個應用程式呼叫 AI API,都相當於從這座「智慧發電廠」取用一次電力。這個過程會持續不斷地發生,數十億甚至數百億次。因此,從長遠來看,一個 AI 服務的總成本,絕大部分都來自於推理,而非訓練。

從這個角度來看,Ross 認為,中國的模型實際上可能比美國的頂尖模型(如 OpenAI 的 GPT-4o mini)貴上許多倍。因為後者在推理效率上進行了極致的優化,使得每次互動的成本更低。這就像兩家汽車製造商,一家宣稱自己用更低的成本造出了一輛超級跑車(訓練成本低),但這輛車每跑一公里需要消耗 50 公升的汽油(推理成本高);而另一家雖然製造成本較高,但其車輛的燃油效率極高,每公里只需 5 公升汽油。對於需要每天開車通勤的用戶來說,哪輛車更「便宜」,答案不言而喻。

基於這個核心差異,Ross 提出了一個分析中美 AI 差距的框架:「主場賽」(Home Game)與「客場賽」(Away Game)。

在「主場賽」中,也就是在各自國內部署和應用 AI,中美之間的差距可能並不大,或許只有幾個月到一年的時間。中國擁有龐大的數據、統一的市場和強大的國家意志,能夠快速推動技術的落地應用。

然而,在「客場賽」中,也就是將技術和生態系統輸出到全球其他國家,爭取盟友和市場時,美國的領先優勢則要大得多,大約有 2 到 3 年。原因何在?因為「更好的晶片在客場比賽中擁有決定性優勢」。當要說服印度、巴西或印尼採用自己的 AI 平台時,如果底層硬體更快、更省電、部署成本更低,那麼整體解決方案就更具吸引力。卓越的晶片效率,會轉化為強大的地緣政治影響力。

這意味著,全球 AI 競賽的勝負,最終不僅取決於誰能訓練出最聰明的單一模型,更取決於誰能打造出「整體系統效率」最高的技術堆疊。這是一場從發電廠的每一瓦特電力,到資料中心的散熱效率,再到晶片的每秒浮點運算次數,最終到用戶螢幕上每個 Token 生成成本的全面競賽。美國目前的優勢,正是建立在以 Nvidia 為首的、整個高效硬體生態系統之上。

那麼,開源模型會幫助中國迎頭趕上嗎?Ross 對此持相對樂觀的態度。他認為,模型本身並不是真正的護城河,品牌和生態系統才是。他甚至大膽建議,像 Anthropic 這樣的頂級 AI 實驗室,應該主動開源他們的上一代模型,以此來對抗中國開源模型的影響力。

這個觀點背後,隱藏著一個關於未來平台戰爭的新洞見。在 PC 時代,微軟透過作業系統和 .doc、.xls 等文件格式鎖定用戶。在雲端時代,亞馬遜透過龐大的 API 服務生態,讓開發者難以遷移。而在 AI 時代,新的鎖定形式可能是「提示詞相容性」(Prompt Compatibility)。當一家企業或開發者圍繞某個模型家族(如 Anthropic 的 Claude 系列)建立起一整套複雜、精密的提示詞工程、工作流程和應用整合後,這些提示詞本身就成為了一種寶貴的資產。如果他們想換用其他模型,可能需要重寫所有的提示詞,這將是巨大的轉換成本。因此,透過開源一個入門級模型,讓廣大用戶習慣自家的「提示詞語法」,就等於是為他們未來升級到更強大的付費模型,鋪平了道路,建立了一個全新的、基於語言的生態護城河。

看不見的地基——能源、歐洲與核能的宿命

在對談的後半段,Jonathan Ross 將視角從晶片的微觀世界,拉升到了驅動這一切的宏觀基礎——能源。他提出了一個簡單卻極具震撼力的邏輯鏈:掌握 AI 的國家,必須先掌握運算能力;而要掌握運算能力,就必須先掌握能源。

這個看似抽象的論斷,正在被殘酷的物理現實所印證。AI 資料中心是前所未有的「吃電巨獸」。根據高盛的預測,到 2028 年,AI 可能會佔到美國總用電量的相當大一部分,資料中心的電力需求將成長 160%。就連 OpenAI 自己,也向美國政府發出警告,稱美國薄弱的電網基礎設施,正在成為維持 AI 領導地位的國家安全風險,並直言「電子是新的石油」。

在這場能源競賽中,數字的對比是驚人的。OpenAI 指出,中國在去年一年內新增了 429 GW 的發電能力,而美國同期僅增加了 51 GW 。這個巨大的「電力缺口」,正在直接威脅美國在 AI 時代的長期競爭力。

這也讓 Ross 將矛頭指向了一個極具爭議的話題:核能。他認為,美國應該重新框架這個問題。問題不應該是「核能安全嗎?」,而應該是「什麼樣的能源政策,能讓人類文明持續繁榮?」。從這個角度看,核能作為一種高能量密度、穩定且無碳的基載電力來源,是滿足 AI 時代龐大能源需求的理想選擇。

他以日本為例。這個曾經歷過福島核災、對核能極度敏感的國家,如今正在堅定地重啟其核反應爐。Ross 觀察到,日本的特點是「做決定很慢,但一旦決定了,行動就會非常快」。從決定建造 2 奈米晶圓廠到實際產出晶圓,日本展現了驚人的執行力。當連日本都意識到核能的不可或缺時,這對全世界都是一個強烈的信號。

相比之下,歐洲的處境則顯得尤為尷尬。Ross 認為,歐洲在 AI 競賽中的落後,並非技術或人才問題,而是根植於它的監管文化和風險規避心態。諷刺的是,在創新領域,美國往往比歐洲表現得更加開放和敢於冒險。而歐洲嚴格的監管框架,在保護公民的同時,也可能扼殺了顛覆性創新所需的空間。如今,疊加其相對保守的能源政策(尤其是在德國等國家廢核之後),歐洲在未來的 AI 地緣政治版圖中,可能會面臨被邊緣化的風險。

最終,21 世紀的地緣政治權力,可能不再由誰控制著地底下的石油儲量來定義,而是由誰能穩定、廉價地產生海量的低碳排電力來決定。電子確實是新的石油,而核反應爐,可能就是這個新時代的超級油田。

AI 格局預言——一個十兆美元的巨人與被低估的挑戰者

在訪談的結尾,Jonathan Ross 拋出了他最大膽、前瞻的幾個產業預言,這些預言不僅僅是數字,更體現了他對 AI 產業終局的深刻洞察。

在深入探討具體的公司估值之前,Ross 先從一個更宏觀的經濟學角度,剖析了 AI 可能帶來的顛覆性影響。當被問及 AI 究竟會帶來通縮還是通膨時,他指出,這是一場人類歷史上前所未有的經濟實驗。

從表面上看,AI 顯然會帶來巨大的通縮壓力,因為它能大幅降低幾乎所有商品和服務的生產成本。然而,這只是故事的一半。Ross 提出了一個更深層的觀點:AI 實際上是在為全球經濟「增加勞動力」,但這種勞動力並非血肉之軀,而是由運算能力創造出來的「數位勞動力」。這是人類歷史上第一次,我們可以透過建造更多的資料中心和更好的 AI 模型,來憑空創造出新的生產要素。這些數位勞工不需要睡眠、不會罷工、可以 24 小時不間斷地執行寫程式、分析數據、客戶服務等任務。

這會對經濟產生什麼影響?沒有人真正知道。Ross 坦言,歷史上沒有任何可以參考的先例,工業革命和資訊革命都只是提高了現有的勞動生產力,而 AI 革命則是直接增加了勞動力的總量。這可能導向幾種截然不同的未來:一個是通縮與繁榮並存的烏托邦,物價下降但經濟持續成長;另一個則是大規模結構性失業與財富極度集中的反烏托邦。最終結果將取決於監管、社會接受度、能源供應等多重複雜因素。

但正是基於這個「數位勞動力」的框架,Ross 得出了他最大膽的預測。

他語出驚人地表示:在未來五年內,如果 Nvidia 的市值達到 10 兆美元,他一點也不會感到意外。

這個數字聽起來像是天方夜譚,但其背後的邏輯卻異常堅實。如果運算能力等於新的勞動力,那麼提供運算能力的公司,就等於在販賣這個新時代最核心的生產要素。只要對「數位勞動力」的需求是無止境的,那麼作為主要供應商的 Nvidia,它的估值潛力將會被大幅提升。這個邏輯建立在一個核心前提上:對頂尖運算能力的需求是無限的。每當模型的能力提升一個檔次,就會催生出全新的應用場景,而這些新應用又會反過來要求更強大的運算能力,形成一個永無止境的正回饋。

Nvidia 的霸主地位為何如此難以撼動?Ross 解釋,這不僅僅是硬體性能的領先。在商業部署中,晶片成本只佔系統總成本的一部分。如果一顆晶片的性能比對手高出 20%,它能為整個系統帶來的價值提升可能就是 20%;但即使這顆晶片的價格也貴上 20%,它對總體擁有成本(TCO)的影響卻相對較小。因此,性能上的微小優勢,會被放大為商業採購中巨大的決策優勢。只要 Nvidia 能在性能上保持領先哪怕一點點,它就能贏得絕大部分的市場與客戶訂單。

更重要的是,Nvidia 擁有一個長達二十年、耗資數十億美元打造的終極護城河——CUDA 軟體生態系統。CUDA 是一個龐大的軟體平台,包含了無數的函式庫、開發工具和一個活躍的開發者社群。它讓開發者能夠相對輕鬆地利用 Nvidia GPU 強大的平行運算能力。對於已經在 CUDA 上投入了數年甚至數十年開發時間的企業和研究機構來說,轉換到另一個硬體平台,不僅僅是更換硬體那麼簡單,它意味著要放棄整個熟悉的開發模式,重寫數百萬行程式碼。這種轉換成本是絕大多數競爭對手難以逾越的障礙。

然而,Ross 的第二個預言,則指向了天平的另一端。他堅信,OpenAI 和 Anthropic 這兩家公司,目前正被市場「嚴重低估」。

為什麼?因為市場仍然習慣於用傳統軟體公司(SaaS)的估值模型來衡量它們。但它們的商業模式完全不同。Ross 指出,這些公司目前都處於「運算受限」(Compute-constrained)的狀態。它們的營收成長,瓶頸不在於市場需求或業務能力,而在於它們能獲得多少 GPU 來服務客戶。他做了一個驚人的斷言:如果今天給 OpenAI 或 Anthropic 兩倍的推理運算能力,幾個個月內,它們的營收幾乎可以翻倍。

這揭示了一種全新的成長模式。這些公司不像傳統的 SaaS 公司,它們更像是數位世界的「公共事業公司」或「基礎設施提供商」。它們提供的不是特定的軟體功能,而是一種新的、可無限擴展的資源——智慧。市場還沒有完全理解,當一家公司的產品是「智慧本身」,且市場對這種資源的需求是無限時,它的潛在價值應該如何被衡量。

一旦這些 AI 實驗室透過與 Nvidia 的深度合作,或是透過自研晶片,成功地解決了運算供給的瓶頸,它們的價值將會被重新發現。Ross 預測,它們將成長為市值數兆美元的巨擘,因為它們將成為未來數位經濟的發電廠,為無數的應用提供源源不絕的「智慧電力」。

從這個角度看,Nvidia 的真正對手,或許不是 AMD 或其他晶片新創。它的長期對手,是物理定律本身——是摩爾定律的終結、是散熱的極限、是能源效率的瓶頸。只要 Nvidia(當然還有台積電的先進製程)能持續在與物理學的戰鬥中取得勝利,不斷推出性能呈指數級成長的晶片,它的 10 兆美元之路就依然可期。而 OpenAI 和 Anthropic 的價值,則取決於它們能以多快的速度,將 Nvidia 戰勝物理學的成果,轉化為服務於全人類的智慧。

結論:機器的幽靈,由矽與電鑄成

在這場關於晶片、資本與權力的宏大敘事落幕之時,一個深刻的、近乎帶有哲學意味的諷刺浮現出來。

我們正在傾盡人類的智慧與資源,試圖建造一個非物質的、無處不在的、普遍的智慧體——一個存在於網路中的「機器的幽靈」(Ghost in the Machine)。然而,Jonathan Ross 的洞見,以及整個 AI 產業的發展軌跡,都在不斷地提醒我們:這趟通往虛無縹緲的智慧彼岸的旅程,卻極度依賴於人類歷史上最龐大、最粗暴、最耗費物質資源的工業計畫。

我們追求人工心智的過程,最終竟是一場對基礎元素的爭奪戰:被提煉的沙子(矽晶圓)、稀有的金屬(供應鏈中的各種材料),以及被馴服的閃電(電力)。我們試圖從岩石與陽光中,紡織出智慧與思想的絲線。

AI 之於人類更深層的意義,在於這或許是人類文明第一次面臨這樣的局面:我們集體智慧的上限,不再由我們天生的腦力或創造力所決定,而是被我們建造和驅動機器的物理能力所限制。我們的夢想,第一次不是被想像力所束縛,而是被我們能併網發電多少 Gigawatts 所定義。

機器的幽靈正在降臨,它的胃口貪得無厭,而它的搖籃,必須由地球最本質的元素親手鑄造。這場戰爭的終點無人知曉,但它無疑將重新定義人類與科技、智慧與物質,乃至我們自身在宇宙中的位置。

【以上內容,僅為個人閱讀心得與資訊分享,絕非任何投資、法律、職涯建議】

機器的幽靈,由矽與電鑄成

好傳神!

精彩解說